AI 人声去除和音轨分离是如何工作的

从 Demucs 到 CreateMusicAI:用更技术但易懂的方式解释 AI Vocal Remover 和 AI Stem Splitter 背后的音频分离原理。

大家常说,烤好的蛋糕没法再变回鸡蛋和面粉。在音频里,把一首完成后的歌曲拆成人声、鼓和贝斯,曾经也很像这件事:你能听出里面有哪些“原料”,但很难把它们干净地分开。AI 声源分离并不会真正恢复录音棚里的原始工程文件,但它现在已经可以做出非常有用的高质量估计。

这也是为什么很多音频工具一开始面对的,都是一个非常实际的问题:我能不能把这首歌里的人声去掉?或者,我能不能把一首完整的歌曲拆成几个可以继续使用的部分?

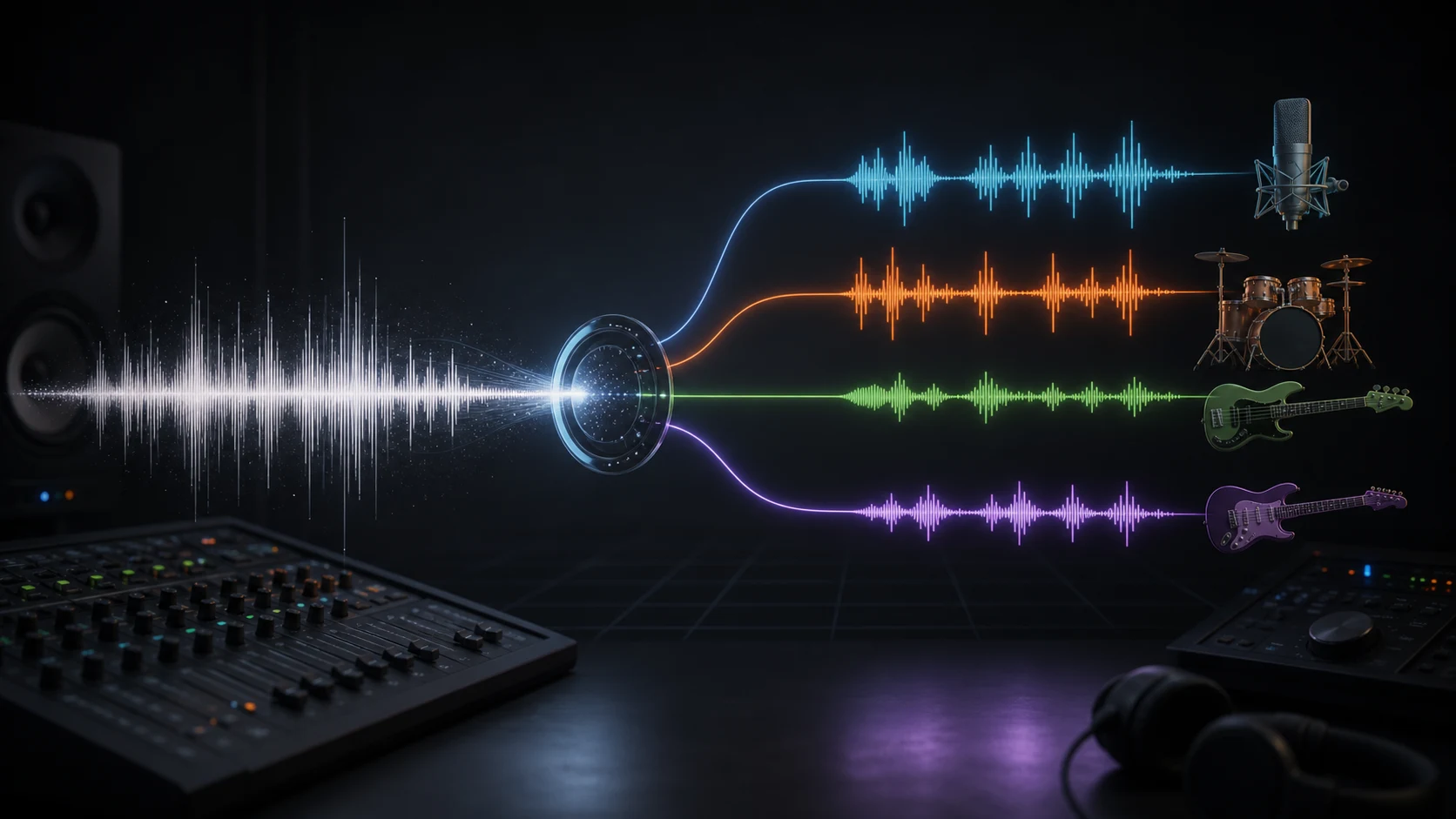

对普通听众来说,一首完成后的歌听起来就是一个整体。但对制作人、DJ、歌手、音乐老师或内容创作者来说,同一首歌里可能藏着很多有价值的层次:人声旋律、鼓组律动、贝斯声部,以及其他乐器和编曲元素。AI 人声去除和 AI 音轨分离的目标,就是把已经混合在一起的成品音乐,重新拆成可以使用的音频素材。

这个想法听起来很简单:上传一首歌,选择想要的模式,然后下载结果。但在背后,这其实是音乐 AI 里一个相当有挑战的问题。音频文件里并没有单独标好“人声”“鼓”“贝斯”的文件夹。它只有一条已经混合好的波形,而所有声音都在时间、频率、响度、声像和混响里互相重叠。

这也是为什么现代工具会使用 Demucs 这样的源分离模型,而不是只依赖 EQ 滤波或中置声道抵消这类传统方法。

什么是 Source Separation

Source separation,中文通常可以理解为“声源分离”或“音源分离”,指的是从一个混合音频信号里估计出不同的声音来源。在音乐场景里,最常见的目标是 vocals、drums、bass 和 other,也就是人声、鼓、贝斯和其他乐器。当模型把一首歌分成这四个输出时,我们通常把这些结果叫作 stems。

AI Vocal Remover 可以看作是同一类问题的一个更聚焦版本。它不是要求模型输出四个 stems,而是输出两个大的部分:

- vocals,也就是人声

- accompaniment,也就是去掉人声后的伴奏

这个模式非常适合制作 karaoke 伴奏、提取 acapella、翻唱练习、人声分析、remix 草稿,以及快速制作 backing track。Stem separation 则会进一步拆分伴奏部分,输出 vocals、drums、bass 和 other,因此更适合 remix、采样、练习单独乐器声部,或者分析一首歌的编曲结构。

这两个工作流背后的核心问题是一样的:模型需要“听”一首已经完成混音的歌曲,并推断哪些部分更可能属于某一个声源。

为什么成品歌曲很难拆开

如果音乐真的能按照频率整齐分区,音轨分离就会很简单。我们可以把低频当作贝斯,把高频当作镲片,把中频当作人声。可真实音乐完全不是这样。

人声可能和吉他、合成器、钢琴、军鼓、房间反射声处在相同的频率范围。底鼓和贝斯可能共享同一个低频空间。人声的混响尾音可能散布在整个立体声声场里,和 pad 或背景乐器融合在一起。母带阶段的压缩还会进一步把这些声音粘合在一起。

这也是早期人声去除方法经常不稳定的原因。很多旧方法假设主唱位于声场中央,然后尝试抵消中置声道。这在某些歌曲上确实能起作用,但它也可能同时削掉底鼓、贝斯、军鼓,或者任何同样被混在中间的声音。面对混响、和声、立体声效果和现代密集编曲时,它会明显吃力。

AI 声源分离不一样。它不是简单切掉某个频段,也不是只抵消某个声像位置。它使用训练好的模型去识别不同声音的模式:人声通常是什么形态,鼓在时间上如何变化,贝斯如何构成低频轮廓,其他乐器又如何填充编曲空间。

工作流背后的 Demucs

Demucs 是一个开源音乐源分离项目,由 Alexandre Defossez 创建,最早在 Meta AI 开发。当前项目介绍中,Demucs 被描述为一个先进的音乐源分离模型,可以把歌曲分离成 drums、bass、vocals 和 other accompaniment。

和现代使用最相关的版本是 Hybrid Transformer Demucs,通常简称为 HTDemucs。项目中把它描述为一种使用 Transformer 的混合 spectrogram 和 waveform 分离模型。简单说,它既能利用随时间变化的原始音频波形,也能利用“频率随时间变化”的视角来观察混音。waveform 部分有助于保留时序、瞬态和声音细节;spectrogram 部分有助于识别谐波结构和频率模式。Transformer 层则提供更长范围的音乐上下文,让模型把一段人声、一个鼓组 groove 或一条贝斯线理解成随时间展开的音乐事件,而不是一堆孤立的音频切片。

Demucs 也支持类似 --two-stems=vocals 的双 stem 人声模式。用产品语言来说,同一类分离技术既可以支持 vocal remover,也可以支持完整的 stem splitter。

如果你想看更深入的研究细节,可以阅读 Hybrid Transformers for Music Source Separation 论文。

模型实际上在预测什么

这里有一个很重要的区别:AI 分离并不是恢复原始录音棚工程。如果一首歌已经从 DAW 导出、经过母带处理、压缩并发布成一个立体声音频文件,那么原始多轨信息已经不再以一种干净、可逆的方式存储在文件里。

模型做的是有根据的估计。面对一个混合信号,它会预测人声 stem 大概应该是什么样,鼓 stem 大概应该是什么样,贝斯 stem 大概应该是什么样,以及剩下的声音应该放进 other stem 里。模型越强,这些估计就越接近可用的真实结果。

这也是为什么结果可以非常惊艳,但不会是数学意义上的完美。分离出来的人声里可能还会残留一点镲片或吉他质感。伴奏里可能还留有很淡的人声影子,尤其是混响尾音。鼓 stem 里可能带着一点贝斯的起音,特别是当底鼓和贝斯被紧密叠在一起时。这些并不是随机错误,而是问题本身的难点:在成品混音里,不同声源本来就物理重叠。

在一个好的分离结果里,这些 artifacts 会足够小,使输出真正可用。对于 karaoke、练习、remix、采样或音乐分析来说,高质量估计往往已经正是工作流需要的结果。

Vocal Remover 和 Stem Splitter 的区别

Vocal removal 和 stem separation 技术上有关联,但服务的创作目标不同。

AI Vocal Remover 更适合回答一个具体问题:“我能不能去掉主唱?”或者“我能不能提取人声?”它通常输出 acapella 和 instrumental,也就是人声轨和伴奏轨。因此它很适合 karaoke、翻唱练习、人声分析和快速制作 backing track。

AI Stem Splitter 更适合当你想进一步处理整首歌的结构。四 stem 输出会给你 vocals、drums、bass 和 other instruments。它适合用来静音鼓组进行练习、单独听贝斯线、采样 groove、制作 remix、分析编曲,或者在 DAW 里重新平衡歌曲中的不同部分。

从技术角度看,四 stem 分离是一个更细的任务。模型不仅要判断什么是人声、什么不是人声,还要把伴奏进一步拆成有音乐意义的不同组。这很有用,但也意味着边界更多,轻微串音也更容易出现在不同 stems 之间。

该选择哪一种模式,取决于你的目标。如果你想要伴奏轨,使用 vocal removal。如果你想对编曲有更多创作控制,使用 stem separation。

什么会影响分离质量

输入文件很重要。干净的 WAV 或 FLAC 通常比低码率 MP3 提供更多有用细节。高质量音频不能保证完美 stems,但它能给模型更好的信号去分析。

编曲本身也很重要。人声清楚、鼓点明确、贝斯线稳定、层次较分明的歌曲通常更容易分离。密集摇滚混音、大量叠加的合成器、现场录音、失真吉他、人群噪声和很长的混响尾音都会更难处理。这些声音会在频率和时间上相互遮盖。

混音方式同样会产生影响。如果人声带有很重的 delay 和 reverb,干声部分可能分离得很好,但空间感的一部分会留在伴奏里。如果底鼓和贝斯经过强烈 sidechain 或失真处理,它们的低频会更难干净拆开。如果和声、主唱和合成器 pad 位于相似频段,一些质感也可能在 stems 之间移动。

诚实地说,AI source separation 不是一个无损的“反混音”按钮,而是一个很强的重建工具。想得到更好的结果,最好的方式是提供干净的源文件,选择正确的分离模式,并把输出当作可继续创作的素材,而不是期待它完全等同于录音棚里的原始多轨。

为什么 GPU 加速很重要

声源分离比传统音频滤波要重得多。滤波器通常执行的是固定规则,而 Demucs 这样的模型会在音频上运行深度神经网络推理,分析时间、频率和上下文,然后生成新的音频输出。

这也是 GPU 加速重要的原因之一。现代 GPU 天生适合神经网络所需的大量并行计算。把分离任务放在高性能 GPU 上运行,可以让这个流程更像一个好用的工具,而不是一个需要自己搭建环境的技术项目。

我们在 NVIDIA A100 GPU 上运行这部分处理。对用户来说,重点并不是硬件名称本身,而是它带来的体验:更快的周转速度,更稳定地处理较重的模型,并且不需要用户自己安装 Python、CUDA、模型 checkpoint 或命令行工具。

你只需要上传音频,系统会处理背后的重推理工作。

进一步阅读

如果你想更深入了解底层技术,可以从 Demucs repository 和 HTDemucs research paper 开始。关于硬件背景,NVIDIA 的 A100 Tensor Core GPU 页面介绍了这类常用于 AI 工作负载的 GPU 基础设施。

它如何变成 CreateMusicAI 的功能

CreateMusicAI 把这套技术工作流封装成了两个简单工具:AI Vocal Remover 和 AI Stem Splitter。

产品层面的使用方式是刻意保持简单的:无需安装。上传音频文件,选择你想要去除人声,还是进行完整的 stem separation,然后让 A100 GPU 加速处理 接管背后的重计算。你不需要安装 Demucs,不需要配置 GPU 驱动,不需要选择模型文件,也不需要运行命令行。

界面背后是严肃的声源分离技术。界面前面,是一个快速、实用的创作流程:把完成后的歌曲转成 高质量、可直接用于创作的分轨,包括伴奏、人声、鼓、贝斯和 other stems,用于 karaoke、remix、练习、分析和内容创作。

AI 人声消除

上传歌曲并用 AI 分离人声和伴奏。获取干净的阿卡贝拉或伴奏,用于卡拉OK、混音、学习或内容创作——无需安装软件。